https://arxiv.org/abs/2112.10752

High-Resolution Image Synthesis with Latent Diffusion Models

By decomposing the image formation process into a sequential application of denoising autoencoders, diffusion models (DMs) achieve state-of-the-art synthesis results on image data and beyond. Additionally, their formulation allows for a guiding mechanism t

arxiv.org

이번 주제는 아주 유명한 Stable Diffuion 논문을 리뷰해보도록 하겠습니다.

Introduction

1. 기존 Diffusion Models 의 문제점

- DMs 는 pixel space 에서 학습하기 때문에, 모든 픽셀 단위로 기울기 계산과 반복적인 연산이 필요

- 이 과정에서 사람이 인식하지 못하는 미세한 세부 디테일(High-Frequency Details) 까지 학습하려고 하면서 불필요한 계산량이 발생

2. 2 단계 학습 과정 (Perceptual Compression → Sementic Compression)

1 단계: Perceptual Compression (지각적 압축)

- Autoencoder 로 고주파(High-Frequency) 정보를 제거하는 단계

- 잠재 공간으로 압축

- 이 과정에서는 세부적인 디테일은 사라지지만, 여전히 의미 있는 (semantic) 정보는 잘 유지

2단계: Sematic Compression (의미 압축)

- 잠재 공간에서 의미적 정보(semantic information) 를 학습하는 단계

- Diffusion Model 로 의미 있는 데이터를 생성

- 즉, 데이터의 본질적인 패턴이나 개념적 구성을 배움

정리 : LDMs 는 Latent Space 를 활용하여 더 나은 품질 유지 + 자원(시간/메모리) 효율성 확보!

→ LDMs 는 Autoencoder 를 먼저 학습시켜서 데이터를 잠재공간(latent space) 로 변환

→ 잠재 공간은 차원은 낮지만, 원본 이미지의 의미(Perceptual Equivalence) 는 유지

→ 한 번 학습한 범용(universial) Autoencoder 를 여러 Diffusion Model 학습과 다양한 작업에 재사용 가능

Related Work

1. Generative Models for Image Synthesis

- Generative Adversarial Networks (GANs) [26]:

- 고해상도 이미지 생성에 효과적이며 좋은 시각적 품질을 보여줌

- 그러나 최적화가 어렵고 전체 데이터 분포를 포괄하는 데 한계가 있음 (mode collapse 문제)

- Likelihood-Based Models:

- 데이터 분포를 더 잘 모델링하기 위해 밀도 추정(density estimation)에 집중

- Variational Autoencoders (VAEs) [45]:

- 효율적인 고해상도 이미지 생성을 지원하지만, 샘플 품질이 GAN보다 낮음

- Flow-Based Models [18, 19]:

- 이미지의 정확한 밀도 추정 가능

- 그러나 복잡한 구조로 인해 샘플링 속도가 느림

- Autoregressive Models (ARMs) [6, 10, 91, 92]:

- 강력한 밀도 추정 성능을 보이지만,

- 순차적 샘플링 과정으로 인해 저해상도 이미지에 제한됨

- 계산 비용이 매우 높음

2. Diffusion Models (DMs)

- Diffusion Probabilistic Models (DMs) [79]:

- 밀도 추정 및 샘플 품질에서 SOTA 달성

- UNet 기반 구조가 이미지 데이터에 적합하여 좋은 성능을 보임

- Reweighted Objective [29]:

- 이미지 품질과 압축 효율 간의 균형을 맞춤

- 하지만 여전히 낮은 추론 속도와 높은 학습 비용 문제가 존재

- 고해상도 확장 문제:

- 픽셀 기반의 DMs는 고해상도 이미지에 대해 매우 높은 계산 비용 요구

- 이를 해결하기 위해 ARMs와 DMs를 결합한 2단계 접근법이 제안됨

3. Two-Stage Approaches

- VQ-VAEs [65, 97]:

- 잠재 공간(latent space)에서 압축된 이미지 분포를 모델링

- Autoregressive 모델과 결합하여 성능 개선

- VQGANs [23, 99]:

- Adversarial Loss와 Perceptual Loss를 결합하여 고품질 이미지 생성

- 그러나 과도한 압축으로 인해 디테일 손실 가능성

- LDMs의 차별점:

- 잠재 공간(latent space)에서 Diffusion Models를 학습하여

- 과도한 압축 없이 높은 품질 유지 및 효율적인 계산 가능

- 기존 방법보다 더 나은 확장성과 일관된 품질 제공

Method

LDMs는 고해상도 이미지 생성을 위한 Diffusion Models (DMs)의 높은 계산 비용을 줄이기 위해 다음과 같은 방식을 제안

- 학습 단계 분리:

- 압축 단계(Compressive Phase) 와 생성 단계(Generative Phase) 를 명확히 분리

- Autoencoder를 활용해 원본 이미지와 지각적으로 유사하지만 계산 비용이 낮은 잠재 공간을 학습

- 효율성 향상:

- 고차원 픽셀 공간을 벗어나 저차원 잠재 공간에서 샘플링 수행 → 계산 효율성 대폭 향상

- UNet 구조의 활용:

- DMs의 UNet 구조가 가진 공간적 구조 학습 능력 (Inductive Bias) 을 활용

- 기존 방법과 달리 과도한 압축 없이도 효율적인 학습과 높은 품질 유지 가능

- 범용성:

- 학습된 잠재 공간은 다양한 생성 모델 학습에 재사용 가능

- CLIP 기반의 이미지 생성 등 다양한 다운스트림 작업에도 활용 가능

Perceptual Image Compression

"이미지를 잠재공간으로 압축하여 계산 효율성 높이기"

1. Perceptual Image Compression 구조

2. 손실 함수 및 학습 방식

- Perceptual Loss [102]:

- 단순한 픽셀 기반 손실(L1, L2) 대신, 시각적으로 중요한 특징을 유지하기 위한 손실 사용

- 이로 인해 블러 현상 없이 선명한 재구성 가능

- Patch-based Adversarial Loss [20, 23, 99]:

- GAN 스타일의 패치 기반 판별기(discriminator)를 사용하여 지역적(realistic) 디테일 유지

3. 잠재 공간의 안정성 확보

- KL Regularization (KL-Reg):

- VAE처럼 잠재 공간의 분포를 정규화하기 위해 KL Divergence를 적용

- 이를 통해 과도한 분산(high variance)을 방지

- Vector Quantization Regularization (VQ-Reg):

- VQ-GAN [23] 스타일의 벡터 양자화(quantization) 사용

- 잠재 공간의 표현력을 높이면서도 안정적인 학습 가능

📌결국, 완만한 압축으로 높은 재구성 품질을 유지하면서도 효율적인 Autoencoder 로 빠른 학습 및 추론이 가능해졌다.

| 기존 방법 [23, 64] | LDMs의 접근 방식 |

| 1D 순서 기반의 압축 → 구조적 정보 손실 가능성 | 2D 구조를 유지하여 공간적 정보 보존 |

| 과도한 압축 필요 → 품질 저하 | 완만한(mild) 압축으로 높은 재구성 품질 유지 |

| AutoRegressive 모델에 의존 → 계산 비용 증가 | 효율적인 Autoencoder로 빠른 학습 및 추론 가능 |

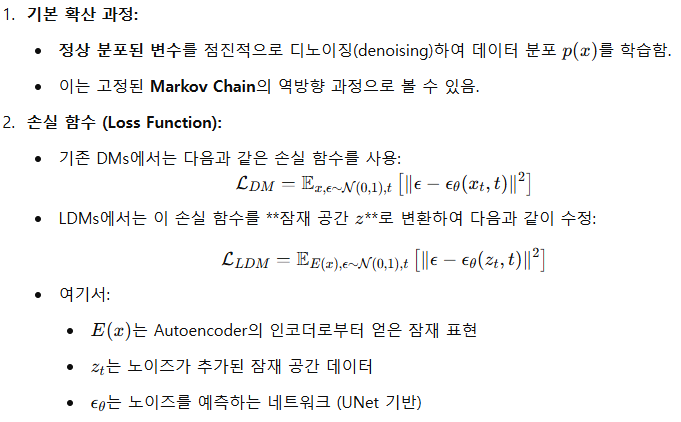

Latent Diffusion Models

- 기존 Transformer 기반 모델과 달리, 2D Convolution 기반 UNet 구조를 활용 → 공간적 패턴 학습에 강점

- 잠재 공간은 다양한 생성 모델 학습에 재사용 가능

- 텍스트-이미지 변환, 인페인팅, 초해상도 등의 작업에 쉽게 적용됨

기존 방법과의 차별점

- 기존 접근법 [23, 64, 99]:

- Autoregressive 모델 또는 Transformer 기반의 Attention 모델을 사용

- 강한 압축과 이산형(discrete) 잠재 공간을 활용 → 계산 비용 높음

- LDMs의 접근법:

- UNet 기반의 구조 활용 → 2D Convolution 중심

- 이미지 데이터의 특성을 잘 반영한 구조로, 공간적 패턴 학습에 강점

- 손실 함수를 조정하여 의미 있는 정보(Perceptual Information)에 집중

Conditioning Mechanisms

🎨 LDMs 에서 이미지 생성과정을 제어(control) 하기 위한 방법

이를 통해 텍스트, 이미지, 시맨틱 맵 등 다양한 조건에 맞춰 이미지를 생성할 수 있다.

- 기본 아이디어

- 조건 정보 y 를 추가하여 모델이 원한는 방향으로 이미지를 생성하게 유도함

- LDMs 에서는 Concatenation 과 Cross-Attention 두가지 방식을 사용

🔹 (i) Concatenation (단순 연결)

- 잠재 표현 z와 조건 정보 y 를 그냥 붙이는 방식(concatenation)

- 간단한 이미지-이미지 변환(ex: 초해상도, 인페인팅)에 효과적

- 한계: 복잡한 조건(ex: 자연어 텍스트)에는 비효율적

🔸 (ii) Cross-Attention (교차 주의 메커니즘)

- Transformer의 Attention 메커니즘을 활용한 방법

- 조건 정보 y를 임베딩(embedding)하여 잠재 표현 zt에 연결

- 특히 텍스트-이미지 변환 같은 복잡한 작업에 강력함

🎯 Cross-Attention 수식:

이 메커니즘을 통해 잠재 표현과 조건 정보가 상호작용하며 더 정교한 이미지 생성이 가능해진다.

LDMs의 유연성 (Flexibility)

- 텍스트-이미지 변환 (Text-to-Image): 자연어 설명을 기반으로 이미지 생성 가능

- 시맨틱 맵 기반 생성 (Semantic Synthesis): 시맨틱 맵을 활용한 풍경 이미지 생성

- 초해상도 (Super-Resolution) & 인페인팅 (Inpainting): 저해상도 이미지를 고해상도로 복원하거나 마스크된 부분을 채움

Experiments

On Perceptual Compression Tradeoffs

잠재공간으로의 압축이 이미지 품질과 계산 효율성에 미치는 영향을 분석

→ 얼만큼 압축해야 효율성을 높이면서도 최상의 이미지 품질을 유지할 수 있는지에 대한 균형을 찾는것이 핵쉼!

다양한 다운샘플링 계수 f를 실험: f∈{1,2,4,8,16,32}

- LDM-1: 픽셀 기반 Diffusion Model (압축 없음)

- LDM-4, LDM-8: 중간 수준의 압축

- LDM-32: 매우 강한 압축

(i) 작은 압축 비율 (LDM-1, LDM-2):

- 느린 학습 속도

- 높은 계산 비용 (픽셀 기반이므로 많은 연산 필요)

- 높은 품질 가능성이 있지만, 비효율적

(ii) 과도한 압축 (LDM-32):

- 빠른 학습 속도

- 그러나 중요한 정보 손실로 인해 품질 저하

- 일정 단계 이후 성능이 더 이상 개선되지 않음 (성능 정체 현상)

(iii) 최적의 균형 (LDM-4 ~ LDM-16):

- 효율성과 품질의 최적 균형 달성

- 높은 압축률을 가지면서도 FID (Fréchet Inception Distance) 점수가 우수함

- LDM-4와 LDM-8이 가장 효율적이며 높은 품질 유지

Image Generation with Latent Diffusion

FID, IS 와 Precision, Recall 에 대한 설명은 다음 링크를 참고해주세요. Metrics 설명 참고

Conditional Latent Diffusion

Transformer Encoders for LDMs

텍스트-이미지 변환 (text-to-image generation) 과 같은 복합적인 조건부 생성(task) 를 수행하기 위해 Cross-Attention 기반의 Transformer 을 도입함.

- τθ 로 표시되는 Transformer Encoder 를 통해 텍스트 임베딩을 생성하고 이를 UNet 구조에 연결함

- 이 과정에서 BERT Tokenizer 를 사용하여 텍스트를 토큰화하고, Transformer 를 통해 임베딩된 벡터를 생성함.

Convolutional Smapling Beyond 256^2

- Semantic synthesis 란?

- Semantic synthesis 는 시맨틱 맵(Semantic Map) 을 입력으로 받는다.

- 해당 레이아웃 구조에 맞는 이미지를 생성하는 기술

- 예를 들어, 하늘, 산, 강 같은 요소들이 구분된 시맨틱 맵을 주면, 이 구조를 따르는 현실적인 풍경을 만들어낼 수 있음

- Convolutional Sampling 방식

- 기존 LDM 는 주로 고정된 해상도에서 학습됨

- 이 절에서는 Convolutional Sampling 을 통해 고해상도 이미지 (최대 1024*1024 픽셀)까지 생성가능

- conv 연산은 위치에 불변하므로, 모델이 더 큰 해상도에서도 일관된 결과를 생성할 수 있음

- Semantic Map 활용 방법

- 시맨틱 맵을 잠재 표현(Latent Representation)에 직접 연결(concatenate)

- 이로 인해 모델이 시맨틱 구조를 유지하면서 이미지를 생성할 수 있음

- 입력 해상도: 256² (384²에서 crop)으로 학습했지만, 512² ~ 1024²의 고해상도에서도 일반화 가능

LDM 손실 함수에서 y가 바로 시맨틱 맵 정보로, 이미지 생성 과정에 직접적으로 영향을 준다.

Super-Resolution with Latent Diffusion

- Super-Resolution (SR)이란 저해상도 이미지를 고해상도로 변환하는 기술

- LDMs 를 통해 기존 모델 대비 더 빠르고 효율적으로 고품질의 이미지를 생성할 수 있다.

- 저해상도 이미지를 UNet 입력에 concaternation (직접 연결) 하여 학습

- 위의 그림에서 SR3는 기존의 SR 모델

- 위의 그림에서 bicubic interpolation 은 저해상도 데이터를 생성을 위해 사용된다. (저해상도 전처리)

- 문제점 : Bicubic 전처리가 적용되지 않은 이미지에는 일반화 성능이 떨어짐

- 다양한 데이터 손상(degradation) 을 포함하는 범용 모델(LDM-BSR) 을 추가 학습하여 일반화 성능 개선

Inpainting with Latent Diffusion

- Inpainting 은 이미지가 손상되었거나 불필요한 부분을 자연스럽게 복원하거나 새로운 콘텐츠로 채우는 작업

- 기존 방법인 LaMa 와 같은 모델은 Fast Fourier Convolutions 기반의 특수한 아키텍처를 사용

- 하지만 LDM 에서는 특수한 구조 없이 범용적인 이미지 생성 모델로 높은 품질의 인페인팅 가능

- 다양한 조건부 이미지 생성 작업에 동일한 모델 구조 활용 가능

- 인페인팅 모델 구성

- LDM-1: 픽셀 기반의 조건부 Diffusion Model

- LDM-4: 잠재 공간(latent space) 기반의 Diffusion Model

- KL 및 VQ 정규화 방식 비교

- Attention 유무에 따른 성능 차이 분석

- 조건부(Conditional) 방식 사용

- 원본 이미지의 손상되지 않은 부분과 mask 를 조건으로 모델에 제공

- 학습 과정 요약

- 손상된 이미지 + 마스크 → 인코더로 잠재 표현 변환

- 노이즈 추가 (Forward Process)

- UNet 모델로 노이즈 제거 (마스크를 참고하여 손상 부분 복원)

- 디코더로 고품질 이미지 복원

- 손실 함수로 예측된 결과와 실제 이미지의 차이를 최소화하며 학습

'😎AI > Generative AI' 카테고리의 다른 글

| [Paper Review] 📌Attention Is All You Need (aka. Transformer) (0) | 2025.02.11 |

|---|---|

| [Paper Review] Classifier-Free Diffusion Guidance (0) | 2025.02.05 |

| [코드공부][Deepfake defection] SeqDeepFake (0) | 2023.07.20 |

| [Paper Review][Generative AI] SeqDeepFake: Detecting and Recovering Sequential DeepFake Manipulation (0) | 2023.07.17 |

| [Paper Review][Computer Vision] Bringing Old Photos Back to Life (0) | 2023.07.15 |